"Bei mir lief das doch noch eben." Diesen Satz hört jedes Entwicklungsteam mindestens einmal pro Sprint. Ein Build läuft lokal grün, die Testumgebung sieht ihn rot, der Kunde sieht ihn gar nicht. Docker hat dieses Problem in den letzten Jahren von einem ungelösten Dauerthema zu einer Frage von zehn Zeilen YAML gemacht. Wir schauen heute auf das Was, das Warum und vor allem auf das Wie der Anwendung in Qualitätssicherungs- und Test-Projekten.

Was ist Docker? In 90 Sekunden

Docker ist eine Plattform für Container-Virtualisierung. Eine Anwendung wird gemeinsam mit allen Abhängigkeiten (Laufzeit, Bibliotheken, Konfiguration) in einem isolierten Paket verpackt. Dieses Paket läuft auf jedem System identisch, egal ob es ein Entwickler-Notebook, ein Build-Server oder ein Kubernetes-Cluster ist.

Die Plattform wurde 2013 von Solomon Hykes als Open-Source-Projekt veröffentlicht und ist heute der De-facto-Standard für Container-Workflows. Docker steht für drei Dinge:

- Ein Format für Container-Images (mittlerweile als OCI-Standard versioniert).

- Eine Engine, die diese Images als laufende Container ausführt.

- Ein Ökosystem aus Registries, Compose-Files und Orchestrierungs-Tools.

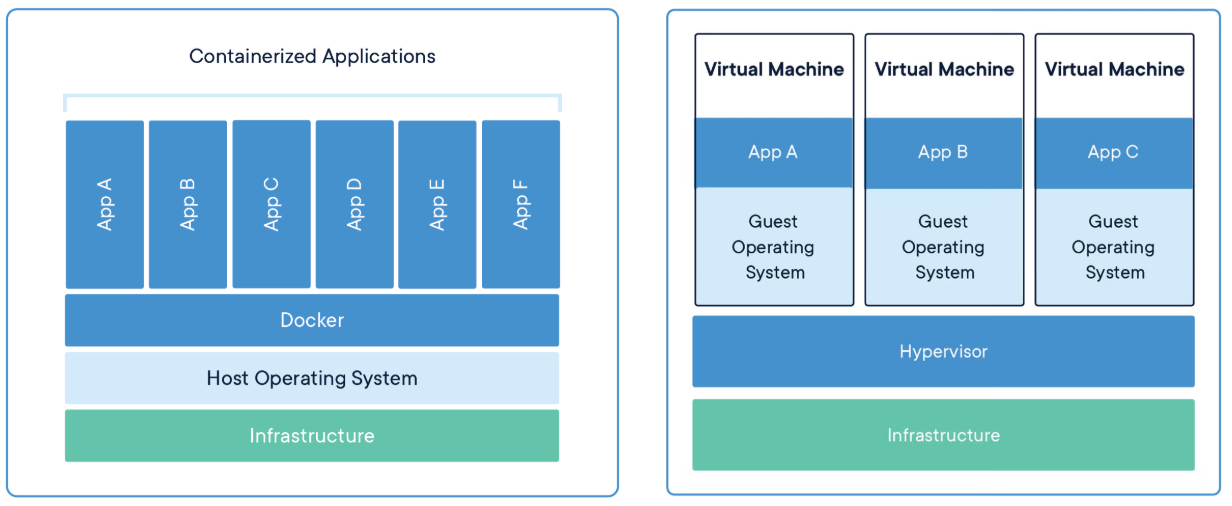

Container vs. virtuelle Maschinen: Wo der Unterschied wirklich liegt

Container und virtuelle Maschinen lösen ähnliche Probleme mit unterschiedlichen Mitteln. Eine VM bringt ein komplettes Gast-Betriebssystem mit, läuft auf einem Hypervisor und belegt typischerweise mehrere Gigabyte. Ein Container teilt sich den Kernel mit dem Host, packt nur die Anwendung plus ihre Abhängigkeiten ein und startet in Sekunden statt Minuten.

Für ein Testteam macht dieser Unterschied einen praktischen Effekt: Eine Test-Pipeline, die zehn frische Datenbanken pro Build hochzieht, ist mit Containern eine Frage von Sekunden. Mit VMs wird daraus ein Wartezimmer.

| Kriterium | Container | Virtuelle Maschine |

|---|---|---|

| Start-Zeit | Sekunden | Minuten |

| Größe | 10 - 500 MB | 2 - 20 GB |

| Isolation | Prozess-Ebene (Namespaces, cgroups) | Hardware-Ebene (Hypervisor) |

| OS-Overhead | Geteilter Host-Kernel | Eigenes Gast-Betriebssystem |

| Typischer Einsatz | Microservices, Test-Stages, CI/CD | Legacy-Systeme, starke Trennung, Multi-OS |

Beide Konzepte haben weiterhin ihre Berechtigung. Wer eine harte Trennung zwischen Workloads braucht (Compliance, Multi-Tenant), greift zur VM. Wer schnell und reproduzierbar bauen will, greift zum Container.

Die sieben wichtigsten Docker-Komponenten

Wer mit Docker arbeitet, begegnet immer denselben Bausteinen. Die folgende Übersicht ordnet sie in der Reihenfolge ein, in der Sie ihnen in einem Projekt typischerweise begegnen.

Docker Engine: Das Herzstück

Die Engine ist der Daemon, der Container ausführt. Sie besteht aus einem Server-Prozess (dockerd), einer REST-API und einem Client (docker auf der Kommandozeile). Die Engine läuft auf Linux nativ, auf macOS und Windows via Lightweight-VM.

Docker Images: Die Bauplane

Ein Image ist eine schreibgeschützte Vorlage, gebaut aus Layern. Jeder Layer beschreibt eine Anweisung im Dockerfile: ein Basis-Betriebssystem, ein installiertes Paket, ein kopierter Quelltext. Layer werden zwischen Images geteilt, was Speicher spart und Builds beschleunigt.

Docker Container: Die Instanz

Ein Container ist die laufende Instanz eines Images. Das gleiche Image kann beliebig oft als Container gestartet werden. Container haben einen schreibbaren Layer obenauf, der beim Beenden verworfen oder als neues Image fixiert werden kann.

Docker Registries: Das zentrale Lager

Eine Registry speichert und verteilt Images. Docker Hub ist die bekannteste öffentliche Registry. Für interne Projekte lohnt sich eine private Registry, zum Beispiel als GitLab Container Registry, AWS ECR, GitHub Container Registry oder Forgejo Registry. Wer geschäftskritische Images aus Docker Hub nutzt, sollte sie regelmäßig in eine eigene Registry spiegeln.

Docker Compose: Mehrere Services orchestrieren

Compose beschreibt in einer YAML-Datei, wie mehrere Container zusammenspielen: Webserver, Datenbank, Cache, Message-Queue. Ein docker compose up startet alles in der richtigen Reihenfolge. Compose ist ideal für lokale Entwicklungs-Stacks und für überschaubare Test-Umgebungen mit drei bis zehn Services.

Swarm und Kubernetes: Container im großen Maßstab

Sobald aus zehn Containern hundert werden und Skalierung, Self-Healing und Rolling Updates relevant sind, schlägt die Stunde der Orchestrierungs-Plattformen. Docker Swarm ist die einfachere Variante mit nativer Docker-Integration. Kubernetes ist der Industrie-Standard mit größerer Lernkurve und größerem Ökosystem.

Docker Desktop: Die Workstation-Lösung

Docker Desktop bündelt Engine, CLI und eine grafische Oberfläche für macOS und Windows. Achten Sie auf die Lizenz: Für Unternehmen mit mehr als 250 Mitarbeitern oder mehr als 10 Millionen US-Dollar Umsatz ist Docker Desktop kostenpflichtig. Alternativen sind Rancher Desktop, Podman Desktop und Colima.

Vorteile und Nachteile von Docker

Vorteile

Die wichtigsten Pluspunkte aus Sicht eines Testteams:

- Reproduzierbarkeit: Das Image, das im Entwickler-Notebook gebaut wurde, läuft 1:1 in der CI-Pipeline und in der Produktions-Umgebung.

- Geschwindigkeit: Container starten in Sekunden. Eine Test-Pipeline mit 50 parallelen Browser-Sessions ist eine Frage von Konfiguration, nicht von Hardware.

- Isolation: Jeder Container bringt seine eigenen Bibliotheks-Versionen mit. Konflikte zwischen Test-Suites verschwinden.

- Versionierung: Images sind unveränderlich und mit einem Tag versioniert. Rollback bedeutet, eine andere Image-Version zu starten.

- Ressourcen-Effizienz: Auf der gleichen Hardware passen typischerweise drei- bis fünfmal so viele Container wie VMs.

Nachteile

Und die Schattenseiten, die in Beratungs-Gesprächen oft erst zu spät auf den Tisch kommen:

- Persistente Daten: Container sind per Design flüchtig. Wer Datenbank-State in Containern hält, braucht Volumes und ein Backup-Konzept.

- Image-Größe: Naive Dockerfiles produzieren schnell ein Gigabyte pro Image. Multi-Stage-Builds und Distroless-Basisimages bringen das auf 100 MB.

- Sicherheits-Layer: Container teilen sich den Host-Kernel. Ein Privilegien-Escape im Container kann den ganzen Host kompromittieren. Image-Scanning und non-root-User sind Pflicht.

- Komplexität bei Skalierung: Ab zwanzig Services wird Compose dünn, Orchestrierung wird zum eigenen Lernpfad.

- Lizenz-Falle Docker Desktop: Wer eine Standardisierung im Unternehmen aufsetzt, sollte die Lizenz-Situation früh klären.

So setzen Sie Docker in QA-Projekten ein

In unseren Test-Engineering-Projekten begegnet uns Docker in vier wiederkehrenden Mustern. Jedes Muster löst ein konkretes Problem, das ohne Container deutlich umständlicher zu adressieren wäre.

Testumgebungen on demand

Eine vollständige Anwendungs-Topologie (Frontend, Backend, Datenbank, Cache, Mock-Services) startet per docker compose up in unter einer Minute. Jeder Tester arbeitet auf einer eigenen, sauberen Umgebung. Test-Daten werden über Seed-Skripte beim Container-Start geladen, dadurch ist jeder Testlauf reproduzierbar.

Parallele Test-Runs in CI/CD

Browser-basierte E2E-Tests skalieren über Container besonders gut. Eine Selenium Grid oder ein Cypress-Cluster mit 20 parallelen Workern entsteht in einer GitHub-Actions- oder GitLab-CI-Pipeline aus wenigen Zeilen YAML. Laufzeiten halbieren sich, Build-Stabilität steigt, weil jeder Test in einer frischen Umgebung läuft.

Performance- und Last-Tests

Für Continuous Performance Testing sind Container fast eine Voraussetzung: Lastgeneratoren als JMeter- oder k6-Container, gestartet über Kubernetes oder AWS Fargate, geben präzise Kontrolle über CPU, Memory und Netz. Ein Lasttest mit 100 Generatoren ist eine Frage von Minuten Setup, nicht Wochen Beschaffung.

API-Mocks und Service-Virtualisierung

Wer Drittsysteme noch nicht testen kann (Schnittstelle in Spezifikation, Vertrag noch nicht final, Test-Account knapp), greift zu Mock-Servern wie WireMock oder Mockoon im Container. Für API-Tests mit Postman oder Newman reicht ein Container in der Pipeline, der die Collection ausführt und Reports schreibt.

In der Praxis kombinieren wir diese Muster: Eine Pull-Request-Pipeline zieht zehn Services hoch, lädt Test-Daten, startet die E2E-Suite parallel, läuft einen Mini-Lasttest, baut Performance-Reports und räumt am Ende alles wieder weg. Ohne Container wäre dieser Workflow betrieblich kaum zu rechtfertigen.

Fazit: Wann Docker für Sie Sinn ergibt

Docker lohnt sich überall dort, wo Reproduzierbarkeit, Geschwindigkeit und parallele Ausführung zählen. Für ein Team mit fünfzig Pipelines pro Tag ist die Frage nicht ob, sondern wie ausgereift das Container-Setup wird. Für ein einzelnes Legacy-System mit einer Datenbank, die seit zehn Jahren so läuft, sind Container kein Selbstzweck.

Wir empfehlen den Einstieg in drei Schritten: Zuerst eine lokale Compose-Umgebung für ein Team. Dann Container in die CI/CD-Pipeline integrieren und parallele Test-Stages aktivieren. Erst danach kommt Orchestrierung mit Kubernetes oder Swarm dazu, wenn die Skalierung es rechtfertigt.

Eine Wahrheit bleibt unabhängig von der Werkzeug-Wahl: Tools wechseln. Qualitätsdenken bleibt. Docker ist ein hervorragendes Werkzeug, aber kein Ersatz für saubere Test-Strategie, sinnvolle Test-Pyramide und ein Team, das Qualität als Ergebnis-Verantwortung versteht. Wenn Sie Ihre Test-Automatisierung in eine Container-Welt heben wollen, sprechen Sie mit unseren Beratern für Continuous Testing.

FAQ: Häufige Fragen zu Docker

Was ist der Unterschied zwischen einem Docker-Image und einem Container?

Ein Image ist eine unveränderliche Vorlage, ein Container ist eine laufende Instanz dieser Vorlage. Aus einem Image lassen sich beliebig viele Container starten, die alle vom gleichen Stand ausgehen. Erst zur Laufzeit werden Container individuell, etwa durch Environment-Variablen oder gemountete Volumes.

Brauche ich Docker, wenn ich Kubernetes einsetze?

Nicht zwingend. Kubernetes spricht über das Container Runtime Interface mit verschiedenen Runtimes (containerd, CRI-O, früher auch Docker). Sie brauchen aber weiterhin Container-Images, die typischerweise mit Docker oder Buildah erzeugt werden. Mehr Hintergrund im Artikel Was ist Kubernetes?.

Ist Docker kostenlos?

Die Engine und die Kommandozeilen-Tools sind Open Source. Docker Desktop ist für Privatpersonen, Bildungseinrichtungen und kleine Unternehmen kostenlos, für größere Unternehmen kostenpflichtig (Stand 2026). Alternativen sind Rancher Desktop, Podman Desktop und Colima.

Wie sicher sind Docker-Container?

Container bieten Prozess-Isolation, keine Hardware-Isolation. In Multi-Tenant-Szenarien oder bei nicht vertrauenswürdigen Workloads sollten zusätzliche Schichten (gVisor, Kata Containers, VMs) ergänzt werden. Pflicht-Hygiene sind Image-Scanning, non-root-User, signed Images und ein dokumentierter Patch-Prozess. Container-Security ist auch ein Thema im Artikel Pentesting Tools 2026.

Eignet sich Docker für CI/CD-Pipelines?

Sehr gut. Praktisch alle aktuellen CI/CD-Systeme (GitHub Actions, GitLab CI, Jenkins, Forgejo, Azure DevOps) starten Build- und Test-Jobs in Containern. Damit ist die Build-Umgebung versioniert, reproduzierbar und unabhängig vom CI-Runner. Wer tiefer einsteigen will, findet Hintergrund im Artikel DevOps Konzept und Tools.

Kann ich mit Docker meine bestehende Legacy-Anwendung modernisieren?

Häufig ja, aber selten als Big-Bang. Wir empfehlen einen schrittweisen Ansatz: zuerst Build- und Test-Umgebungen in Container überführen, dann nicht-zustandsbehaftete Services, am Ende stateful Komponenten mit klarem Backup-Konzept. Eine Migrationsanalyse durch erfahrene Berater spart Wochen.

Was kostet der Wechsel zu einer Container-basierten Test-Pipeline?

Die Werkzeuge selbst sind weitgehend kostenlos. Investitionen entstehen in Know-how-Aufbau, Setup der Pipelines und Anpassung der Anwendungs-Architektur. In typischen mittelständischen Test-Projekten amortisiert sich der Wechsel innerhalb von sechs bis zwölf Monaten durch kürzere Pipeline-Laufzeiten und reproduzierbare Builds.